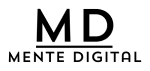

Hands On IA: Regresión Lineal

En nuestro programa Hands On IA, uno de los primeros conceptos que exploramos es la regresión lineal. Y no es casualidad: esta técnica simple pero poderosa permite a cualquier persona comenzar a entender cómo funcionan los modelos de predicción, incluso sin tener conocimientos técnicos previos.

Si lo prefieres, puedes escuchar el podcast de este post:

¿Qué es la regresión lineal?

Ejemplo: Datos Observados

Muchas veces tenemos una serie de puntos (como en la imagen) y queremos encontrar una forma de poder estimar cual será el valor de Y para un valor de X (por ejemplo, queremos estimar las ventas en función de la inversión en marketing).

La regresión lineal nos permite hacer esto, ya que busca encontrar la mejor recta posible que relacione estas dos variables. Para lograrlo buscamos minimizar la distancia entre cada punto de nuestros datos observados y esa recta:

Ejemplo: Recta que minimiza la distancia entre ella y los puntos observados

De esta forma encontraremos la recta que mejor se ajusta a nuestra muestra de puntos. Veamos el modelo detrás de esto.

Definamos una línea:

\[ Y = aX + b \]

Donde:

- Y es la variable que queremos predecir,

- X es la variable independiente,

- a es la pendiente de la recta

- b es el punto de intersección con el eje Y.

¿Cómo se entrena esta recta?

Para ajustar el modelo, usamos funciones de pérdida: medidas que nos indican qué tan lejos están las predicciones de los valores reales.

La más común es MSE (Mean Squared Error: Error Cuadrático Medio):

\[ L(a, b) = J_{\text{MSE}}(a, b) = \frac{1}{n} \sum_{i=1}^{n} (y_i - (ax_i + b))^2 \]

MSE penaliza mucho los errores grandes (por el cuadrado). Si graficamos esta función de pérdida podemos ver que los valores más alejados de la predicción son más castigados, errores pequeños ( 1 o -1) generan perdidas pequeñas (1), pero errores más grandes (5 o -5) generan pérdidas mucho mayores (25):

Función de pérdida MSE

Existen otras funciones de pérdida como:

- MAE (Mean Absolute Error) que promedio el valor absoluto de los errores (en vez del cuadrado), por lo tanto, penaliza de la misma forma a todos los errores, lo que la hace más robusta ante outliers.

- Huber Loss: Combina lo mejor de MSE y MAE. Usa MSE para errores pequeños y MAE para errores grandes. Se define un umbral para ver cuando se usa uno o el otro.

- Log-Cosh Loss: Similar a MSE para más suave (usa el logaritmo del coseno hiperbólico del error).

- Quantile Loss: Se enfoca en estimar cuantiles (no la media).

A modo de ejemplo, comparemos ahora la función de pérdida de MSE vs la de MAE:

Funciones de pérdida: MSE vs MAE

Se puede apreciar, como habíamos indicado, que MAE castiga menos los errores grandes que MSE, esta diferencia es notoria en errores más grandes.

Hands On: ¡Pruébalo tu mismo!

Instrucciones:

- Haz click en el canvas para agregar un nuevo punto.

- Mueve puntos arrastrándolos con el mouse.

- Revisa como cambia la regresión lineal y los errores calculados para los modelos MSE y MAE, cuando agregas o mueves puntos.

- Presiona Reset para limpiar el canvas.

📈 Ecuación MSE: -

📉 MSE: -

📈 Ecuación MAE: -

📉 MAE: -

📌 Haz clic o toca el gráfico para agregar un punto. Arrástralo para moverlo.

📉 Errores MSE

📉 Errores MAE

Como has visto, con solo algunos puntos y una función matemática simple, ya es posible construir un modelo que predice, aprende y se ajusta. Esa es la esencia de la inteligencia artificial: modelar el mundo a partir de los datos.

Este modelo se puede extender fácilmente a multiples variantes independientes (X1, X2 ... Xn) para predecir una variable Y. Por ejemplos las ventas dependen del precio, inversión en marketing, precio de la competencia, cantidad disponible, estacionalidad, etc, donde tenemos una ecuación de la forma:

\[ Y = a1X1 + a2X2 + ... +anXn +b \]

Este modelo sigue la misma lógica que hemos visto, minimizando funciones de pérdida, pero en vez de busca la mejor recta, buscamos el mejor plano (o hiperplano), veremos más adelante que esto se traduce en vectores y matrices, muy utilizados en IA para resolver problemas complejos de forma eficiente.

Puedes ver el resultado en este ejemplo 3D:

En este primer módulo aplicamos regresión lineal para entender cómo una máquina puede aprender relaciones en los datos. Vimos cómo ajustar una recta, cómo evaluar el modelo con funciones de pérdida (MSE y MAE), y cómo representar estos conceptos visualmente.

En los próximos módulos abordaremos nuevos desafíos: clasificación, decisiones no lineales y uso de librerías reales de IA. ¡Nos vemos!